2026년 3월, 미국 새너제이 SAP 센터. NVIDIA GTC 2026 키노트의 오프닝 영상이 시작되자마자 화면에 뜬 건 반도체 칩도, GPU 사진도 아니었습니다. 토큰(token)이라는 단어였어요.

젠슨 황은 무대 위에서 "엔비디아의 토큰 비용은 세계 최고"라고 말했죠. 한 애널리스트는 엔비디아를 "추론의 왕(inference king)"이라고 불렀습니다. GPU 회사 CEO가 GPU 스펙을 말하는 대신 '토큰 비용'을 자랑하는 장면은, 지금 AI 인프라 시장이 어떻게 바뀌고 있는지를 가장 잘 보여주는 순간이었어요.

그런데 저희가 고객사에서 가장 많이 받는 질문은 이것입니다. "토큰이 정확히 뭐예요?"

ChatGPT를 써본 분, Claude로 이메일을 정리해본 분, 생성형 AI 바우처 사업을 검토 중인 분 모두가 비슷한 지점에서 막힙니다. 뉴스에서는 '100만 토큰 컨텍스트'니 '토큰당 얼마'니 계속 나오는데, 그 토큰이 도대체 뭔지 아무도 처음부터 설명해주지 않죠. 이번 글에서는 토큰을 처음 들어보신 분도 끝까지 이해할 수 있도록, AI가 글을 읽는 방식부터 GPU 비용이 왜 중요해졌는지까지 한 번에 풀어드릴게요.

토큰이 뭘까요? AI가 글을 읽는 가장 작은 조각

가장 쉬운 비유로 시작해볼게요. 사람이 책을 읽을 때 우리 눈은 단어 단위로 이동합니다. "오늘 날씨가 좋다"를 읽을 때 글자 하나하나가 아니라 단어 덩어리로 인식하죠.

AI도 비슷한 일을 하는데, 단어가 아니라 토큰(token)이라는 단위로 글을 쪼개서 읽어요. NVIDIA 공식 블로그의 설명을 빌리자면, 토큰은 "더 큰 정보 덩어리를 잘게 쪼갠 작은 데이터 단위"입니다. AI 모델은 이 토큰들 사이의 관계를 학습하면서 예측, 생성, 추론 능력을 갖추게 되죠. NVIDIA 공식 블로그에 자세히 정리되어 있어요.

재미있는 건, 토큰이 우리가 아는 '단어'와 일대일로 맞아떨어지지 않는다는 점입니다. 예를 들어 영어 단어 "darkness(어둠)"는 "dark" + "ness" 두 개의 토큰으로 쪼개져요. 각각에 217, 655 같은 숫자 ID가 붙죠. 반대말인 "brightness(밝음)"도 "bright" + "ness"로 나뉘는데, 여기서 공유되는 "ness"라는 토큰이 있어서 AI가 두 단어 사이의 관계를 학습할 수 있어요.

Microsoft 공식 문서에 따르면, OpenAI의 GPT 모델들은 이런 방식을 BPE(Byte-Pair Encoding)라고 부르는 토큰화 기법으로 처리합니다. 단어를 통째로 쓰지도, 글자 하나하나로 쪼개지도 않고, 그 중간인 서브워드(subword) 방식을 쓰는 거예요. Microsoft Learn 문서에서 토큰 ID가 할당되는 과정을 단계별로 볼 수 있어요.

한 가지 더 중요한 점은, AI는 텍스트 자체를 처리하는 게 아니라 이 토큰들이 변환된 숫자 배열을 계산한다는 겁니다. 우리는 "안녕하세요"라고 입력했다고 생각하지만, 실제로 GPU 내부에서는 이게 [13447, 62060, 24486, ...] 같은 숫자들로 바뀌어 흐르고 있어요. 화면에는 글자가 보이지만, 그 뒤에서는 수학이 돌아가는 셈이죠.

영어 한 단어, 한국어 세 배 토큰이 필요한 이유

여기서 한국어를 쓰는 저희에게 중요한 이야기가 시작됩니다. 결론부터 말씀드릴게요. 같은 내용을 한국어로 쓰면, 영어보다 3~5배 많은 토큰이 필요합니다. 그리고 AI 서비스는 대부분 토큰 개수로 요금을 매기죠.

OpenAI 커뮤니티에서 실제로 이 문제가 2023년부터 꾸준히 제기됐는데요. 공식 포럼에 올라온 실제 테스트 결과 하나를 보여드릴게요. 영화 '기생충'을 설명하는 한국어 한 문단을, GPT-3.5가 쓰는 cl100k_base 토크나이저에 넣으면 103개 토큰이 나옵니다. 반면 한국어 전용 토크나이저인 Kiwi로 처리하면 47개 토큰으로 끝나죠. 거의 두 배 차이예요. OpenAI 개발자 포럼 스레드에 실제 숫자가 그대로 기록되어 있어요.

왜 이런 차이가 날까요? 한국어는 교착어라서 명사에 조사가 붙고, 동사에 어미가 붙어 한 단어 안에 여러 문법 요소가 한꺼번에 담깁니다. 영어는 "I go to school"처럼 단어들이 독립적이지만, 한국어는 "학교에"라는 한 단어 안에 명사와 조사가 같이 들어 있죠. 그런데 GPT 계열이 쓰는 BPE 토크나이저는 영어 중심으로 설계됐기 때문에, 한국어를 만나면 낯설어서 한 글자씩 잘게 쪼개버리는 경향이 있어요.

여기에 또 하나 고려할 게 있습니다. Anthropic이 최근 공개한 Claude Opus 4.7은 새 토크나이저를 쓰는데, 같은 문장에 대해 최대 35% 더 많은 토큰을 사용한다고 공식 문서에 명시되어 있어요. 성능은 좋아졌지만 토큰 단가는 그대로 유지되면서 체감 비용이 올라가는 셈이에요. Anthropic 공식 가격 페이지에서 확인하실 수 있어요.

실무에서 이게 의미하는 건 단순합니다. 같은 문서를 영어로 요약시키는 것과 한국어로 요약시키는 건, 청구서에서 전혀 다른 숫자가 찍힌다는 뜻이에요. 저희가 B2B 고객사에 AI 도입을 안내드릴 때 "한국어 처리 비용은 영어 기준 가격표를 그대로 적용하면 안 된다"고 가장 먼저 말씀드리는 이유가 여기에 있습니다.

입력, 출력, 그리고 '이전 대화 전체'까지

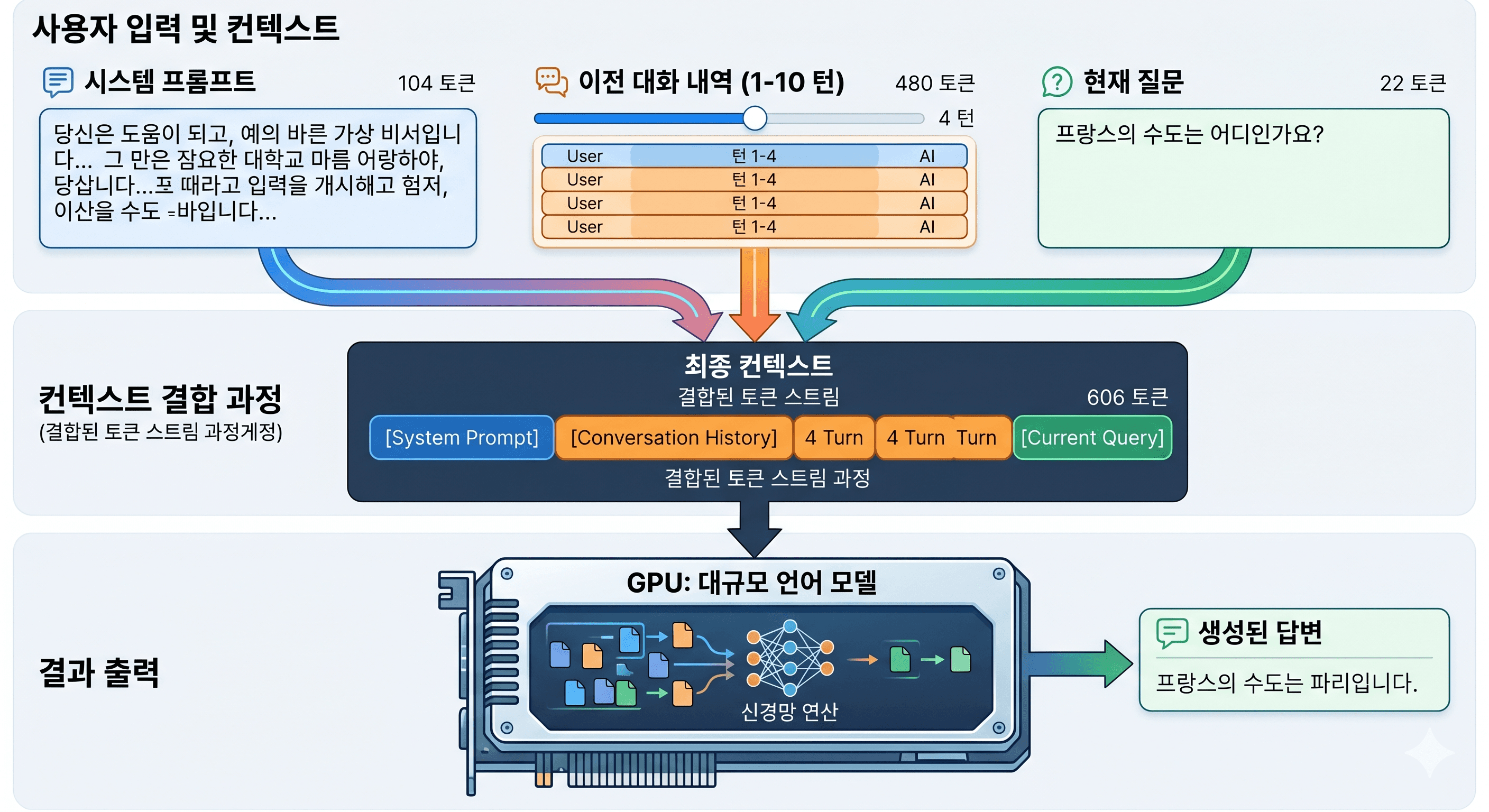

ChatGPT나 Claude 같은 챗봇에게 질문을 하나 던지면, 내부에서는 대략 이런 일이 순서대로 일어납니다.

먼저 입력 텍스트가 토큰화 과정을 거쳐 숫자 배열로 바뀝니다. 그 배열을 GPU가 받아서 계산하고, 다음에 올 확률이 가장 높은 토큰을 하나씩 예측하면서 응답을 만들어내요. 이렇게 예측된 토큰들이 다시 텍스트로 변환되어 화면에 나타나는 거죠.

이 과정에서 요금은 입력 토큰 수 + 출력 토큰 수로 계산됩니다. 그런데 많은 분들이 놓치는 부분이 있어요. 입력에 포함되는 건 단순히 사용자가 방금 친 질문만이 아닙니다.

입력 토큰에는 사용자가 방금 친 질문, AI에게 역할을 부여하는 시스템 프롬프트, 참고하라고 업로드한 문서, 그리고 이전에 오갔던 모든 대화 기록까지 전부 포함됩니다. AI는 단기 기억이 없기 때문에, "아까 말한 그 내용 기억하지?"가 작동하려면 매 요청마다 이전 대화를 전부 다시 입력에 넣어 보내줘야 하거든요.

그래서 대화가 길어질수록 요청당 입력 토큰이 눈덩이처럼 불어납니다. 10번째 질문을 할 때는 앞의 9번 대화가 전부 입력에 들어가죠. 이걸 '컨텍스트가 쌓인다'고 표현하는데, 뒤에서 더 자세히 다룰게요.

한편 출력 토큰은 보통 입력보다 2~5배 비싸게 책정됩니다. DeepSeek-V3.2의 공식 가격을 보면 입력 1M 토큰 $0.28인 반면 출력 1M 토큰은 $0.42로 1.5배이고, Anthropic의 Claude Opus 4.7은 입력 1M 토큰 $5에 출력 $25로 5배 차이가 나죠. 출력은 토큰을 하나씩 순차적으로 생성해야 하기 때문에 계산 자원이 더 들어가요. DeepSeek 공식 가격표와 Anthropic 공식 가격 페이지에서 직접 확인하실 수 있어요.

'생각하는 AI'가 비싸지는 진짜 이유, 추론 토큰

2026년 들어 본격적으로 등장한 새로운 토큰이 있습니다. 추론 토큰(reasoning token)이에요. OpenAI의 o 시리즈, DeepSeek-R1, Claude의 Extended Thinking 모드 같은 '생각하는 AI' 모델들에서만 발생하죠.

일반 모델은 질문을 받자마자 바로 답을 생성합니다. 반면 추론 모델은 답을 내놓기 전에 "잠깐, 이 문제를 이렇게 접근하면... 아니 다른 방법이 더 낫겠다..." 하는 내부 사고 과정을 토큰으로 만들어냅니다. 우리 눈에는 최종 답만 보이지만, 그 뒤에서 수천에서 수만 개의 추론 토큰이 돌아가고 있는 거죠.

NVIDIA 공식 설명에 따르면, 추론 모델은 한 번의 질문에 기존 LLM 대비 100배 이상의 연산을 요구할 수 있다고 해요. 단순한 질문조차 수백에서 수천 개의 추론 토큰을 추가로 쓰고, 복잡한 수학이나 코딩 문제에서는 기본 모델 대비 훨씬 더 많은 토큰을 소비합니다.

추론 토큰은 화면에 보이지 않아도 출력 토큰 요금으로 그대로 과금됩니다. 요약된 답변 몇 줄만 보여도, 내부에서 5천 개의 추론 토큰이 쓰였다면 그 5천 개 전체가 출력 단가로 계산되는 거예요.

Anthropic의 공식 문서에도 이 부분이 명시적으로 나와 있어요. Claude의 Extended Thinking 기능으로 생성된 추론 토큰은 '출력 토큰' 요금으로 청구됩니다. 즉, 화면에는 요약된 답변 몇 줄만 보여도, 내부에서 Claude가 5천 개의 추론 토큰을 썼다면 그 5천 개 전체가 $25/1M 단가로 과금되는 거예요. AWS Bedrock 공식 문서에 청구 방식이 그대로 나와 있어요.

그래서 B2B에서 추론 모델 도입을 검토하실 때는 반드시 두 가지를 점검하셔야 해요. 첫째, 내 업무에서 정말 깊은 추론이 필요한가? 단순 요약·번역·이메일 답변 같은 건 일반 모델이 훨씬 경제적입니다. 둘째, 추론 예산(thinking budget)을 어디까지 허용할 것인가? Claude는 최소 1,024 토큰부터 budget을 설정할 수 있고, 태스크 복잡도에 맞춰 조율하는 게 비용 통제의 출발점이에요.

AI의 단기 기억 한도, 컨텍스트 윈도우

AI가 한 번에 처리할 수 있는 토큰 수에는 상한이 있습니다. 이걸 컨텍스트 윈도우(context window)라고 불러요. 사람의 단기 기억과 비슷한 개념이죠. 이 한도를 넘어가면, 오래된 내용부터 더 이상 AI가 볼 수 없게 됩니다.

2026년 4월 기준, 주요 모델들의 컨텍스트 윈도우를 정리하면 이렇습니다.

모델 | 컨텍스트 윈도우 | 체감 처리량 |

|---|---|---|

Claude Opus 4.7 | 100만 토큰 | A4 약 2,500장 |

Claude Sonnet 4.6 | 100만 토큰 | A4 약 2,500장 |

DeepSeek-V3.2 | 12.8만 토큰 | A4 약 320장 |

컨텍스트 윈도우가 크면 더 긴 문서를 통째로 분석하거나, 더 오래 이어진 대화를 기억할 수 있어요. 그런데 여기에 중요한 함정이 있습니다. 채워진 컨텍스트 전체가 매 요청마다 입력 토큰으로 청구됩니다.

예를 들어 100만 토큰 컨텍스트에 90만 토큰짜리 코드베이스를 올려둔 상태라면, 그 후 "이 함수 버그 찾아줘"라는 짧은 질문 하나에도 매번 90만 토큰이 입력으로 들어가요. 사용자는 한 줄 질문을 던진 것 같지만 GPU는 매번 거대한 문서 전체를 다시 읽고 있는 셈이죠. 이런 패턴을 모르고 쓰다가 한 달 청구서를 보고 놀라시는 팀이 많아요.

그래서 대규모 컨텍스트 활용에는 프롬프트 캐싱(prompt caching)이라는 기술이 필수가 됐어요. 한 번 읽은 컨텍스트를 캐시에 저장해두고, 다음 요청에서는 같은 부분을 다시 계산하지 않는 방식입니다. Anthropic은 캐시 히트 시 입력 비용을 최대 90% 절감할 수 있다고 공식 발표했고, DeepSeek도 캐시 히트 입력 단가가 일반 단가의 10분의 1이에요. 같은 시스템 프롬프트를 반복해서 쓰는 서비스라면 캐싱을 켰을 때와 껐을 때 월 비용이 배 이상 차이 납니다.

에이전트 시대, 토큰이 폭발하는 지점

2026년 AI 업계의 최대 키워드는 에이전트(agent)입니다. NVIDIA GTC 2026에서 젠슨 황은 OpenClaw를 "역사상 가장 인기 있는 오픈소스 프로젝트"라고 소개했고, LangChain, Cursor, Perplexity 대표들이 한 무대에 올라 "AI는 이제 모델이 아니라 시스템"이라고 선언했죠.

에이전트는 단순한 챗봇과 다릅니다. "보고서 하나 써줘"라는 명령을 받으면, 내부에서는 이렇게 움직여요.

먼저 AI가 계획을 세우고, 웹을 검색해서 자료를 읽고, 읽은 내용을 분석하고, 코드를 짜서 데이터를 처리하고, 결과를 검증하고, 다시 쓰고, 마지막에 최종 보고서를 정리합니다. 이 모든 단계가 각각 별도의 AI 호출이에요. 한 번의 사용자 명령이 내부적으로는 수십에서 수백 번의 토큰 요청으로 이어지는 거죠.

실제 수치로 보면 와닿는데요. Morph가 2026년 4월 공개한 분석에 따르면, Claude Code 같은 코딩 에이전트 사용자는 평균 하루 $6, 상위 10%는 하루 $20~50을 씁니다. 5만 토큰짜리 시스템 프롬프트를 Sonnet 4.6에 붙여 20번 요청하면, 캐싱 없이 $3, 캐싱 있으면 $0.47로 떨어져요. 동일 작업에 6배 넘는 비용 차이가 나는 셈입니다.

에이전트 워크로드의 특성은 두 가지예요. 첫째, 컨텍스트가 눈덩이처럼 쌓입니다. 한 태스크가 끝날 때쯤에는 수십 턴의 대화와 수만 줄의 파일 내용이 컨텍스트에 올라가 있죠. 둘째, 실패와 재시도가 많습니다. 에이전트가 한 번에 정답을 내는 경우는 드물고, 버그를 발견하고 되돌리고 다시 시도하는 과정에서 토큰이 배로 들어요. 그래서 기업들이 에이전트 도입 시 가장 먼저 찾는 게 '토큰 예산 통제 구조'입니다.

젠슨 황이 말한 'AI 팩토리'와 토큰의 경제학

여기서 처음에 언급한 GTC 2026 장면으로 돌아가볼게요. 왜 GPU 회사 CEO가 토큰 비용을 자랑했을까요?

NVIDIA는 2026년부터 데이터센터를 AI 팩토리(AI Factory)라고 부르기 시작했습니다. 전통적인 데이터센터가 데이터를 저장하고 처리하는 창고였다면, AI 팩토리는 "토큰을 제조하는 공장"이라는 거예요. 입력으로 전력과 데이터가 들어가면, 출력으로 토큰이 나옵니다. 그 토큰이 수익으로 이어지죠.

이 프레임에서 핵심 지표는 세 가지입니다. 토큰 처리량(throughput), 토큰당 비용(cost per token), 그리고 사용자 경험 지표인데요. 후자는 첫 토큰까지 걸리는 시간(time to first token)과 토큰 간 지연(inter-token latency)으로 측정됩니다. 챗봇이 답을 시작할 때까지 몇 초 걸리는지, 글자가 얼마나 부드럽게 흐르는지, 모두 토큰 지표로 환산되는 거예요.

같은 하드웨어에서 6개월 만에 2.7배. NVIDIA가 공개한 MLPerf Inference v6.0 결과입니다. GB300 NVL72 시스템이 DeepSeek-R1 서버 시나리오에서 처리량을 2.7배 끌어올렸고, 토큰당 제조 비용이 60% 이상 감소했어요. 하드웨어를 교체한 게 아니라 소프트웨어 최적화만으로 낸 결과라는 점이 핵심이에요.

NVIDIA 개발자 블로그에 벤치마크 전체가 공개되어 있습니다. kernel fusion, Wide Expert Parallel, Multi-Token Prediction, KV-aware routing 같은 기법을 쌓아 동일 GPU에서 더 많은 토큰을 뽑아낸 거죠. NVIDIA 개발자 블로그에 전체 수치가 나와 있어요.

젠슨 황은 같은 키노트에서 "지난 몇 년간 컴퓨팅 수요가 100만 배 증가했다"고 말했습니다. 그리고 2025년부터 2027년까지 NVIDIA 매출을 1조 달러 이상으로 전망했죠. 이 숫자들의 공통점은 모두 '토큰'으로 환산된다는 거예요. 토큰을 얼마나 빠르게, 얼마나 싸게 만들어낼 수 있는지가 AI 인프라 사업의 근본 경쟁력이 되었습니다.

저희 고객사들이 GPU 서버 구성을 문의해주실 때 가장 많이 바뀐 질문도 여기에 있어요. 2024년까지는 "H100 몇 장이 필요한가요?"였다면, 2026년 지금은 "우리 워크로드에서 토큰당 비용이 얼마나 나올까요?"로 옮겨가고 있습니다.

B2B 팀이 바로 적용할 수 있는 토큰 비용 절감법

지금 당장 팀에 적용할 수 있는 다섯 가지를 정리해드릴게요.

1 — 프롬프트 캐싱을 최대한 활용하세요

같은 시스템 프롬프트, 같은 문서, 같은 코드베이스를 반복해서 쓰는 워크플로라면 캐싱만 잘 걸어도 입력 비용이 50~90% 줄어듭니다. Anthropic과 DeepSeek 모두 공식 기능으로 제공하고 있고, API 요청에 설정 한 줄로 끝나요. RAG, 내부 지식베이스 챗봇, 코드 어시스턴트 워크로드는 캐싱 여부가 한 달 청구서를 결정합니다.

2 — 태스크에 맞는 모델을 선택하세요

요약·분류·번역 같은 단순 작업에 Opus 4.7을 쓰면 Haiku 4.5의 5배 가격을 지불하는 꼴입니다. 프리미엄 모델은 복잡한 추론과 장기 에이전트 워크플로에만 쓰고, 일상 업무는 경량 모델로 처리하는 게 경제적이에요. 저희 고객사 중에서도 모든 파이프라인을 한 모델로 통일했다가, 라우팅을 도입해 월 비용을 절반으로 낮춘 팀이 있었어요.

3 — max_tokens로 출력 길이를 제한하세요

API를 쓰신다면 응답 길이에 상한을 걸어두세요. 대부분의 답변은 500~1,500 토큰 안에서 끝나는데, 제한 없이 두면 AI가 쓸데없이 길게 생성해 비용을 올리는 경우가 많아요. 특히 출력 토큰은 입력보다 비싸기 때문에, 불필요한 장문은 직접적인 비용 손실로 이어집니다.

4 — 추론 모드는 선택적으로 켜세요

Claude의 Extended Thinking, GPT의 Reasoning 모드는 기본적으로 꺼두고, 복잡한 문제가 왔을 때만 켜는 게 좋습니다. 추론 예산(thinking budget)을 태스크 복잡도에 맞춰 1,024에서 4,096 사이에서 조율하세요. 단순 질문에 추론 모드를 기본으로 켜두면 과잉 사고로 비용만 늘어납니다.

5 — 한국어는 요약 후 영어로 처리하는 방법도 고려하세요

대량 문서 처리 워크플로라면, 한국어 원문을 요약한 뒤 영어 기반 모델에 보내는 2단계 구조가 토큰을 크게 아낄 수 있어요. 다만 뉘앙스 손실이 생길 수 있어, 최종 아웃풋 품질을 팀이 검증하고 도입해야 합니다. 민감한 한국어 표현이 핵심인 리걸·의료 분야에서는 권장하지 않아요.

자주 묻는 질문

Q1. 토큰 개수를 미리 계산할 수 있나요?

네, OpenAI의 tiktoken, Anthropic의 토큰 카운팅 API 같은 도구로 요청을 보내기 전에 미리 토큰 수를 확인할 수 있어요. 프로덕션 환경이라면 대량 요청 전에 토큰 수를 먼저 로깅해두는 습관이 필수입니다.

Q2. 한국어 대신 영어로 프롬프트를 쓰면 훨씬 싼가요?

같은 내용 기준으로는 맞아요. 3~5배 차이가 나는 경우도 있어요. 다만 모델이 한국어 태스크에 최적화되어 있지 않으면 출력 품질이 떨어질 수 있어서, 영어 프롬프트 + 한국어 응답 같은 혼합 전략도 실무에서 많이 씁니다.

Q3. 온프레미스 GPU 서버로 토큰 비용을 줄일 수 있나요?

워크로드 규모에 따라 다릅니다. 월 수백만 토큰 이하면 API 이용이 경제적이고, 하루에 수천만에서 수억 토큰 이상 꾸준히 쓴다면 자체 GPU 인프라가 더 유리해질 수 있어요. 저희가 워크로드 데이터를 받아 시뮬레이션해드리는 경우도 많습니다.

Q4. 오픈소스 모델을 쓰면 토큰 비용이 아예 없는 건가요?

API 비용은 없지만, 자체 GPU 서버 운영 비용(전력, 냉각, 인프라 관리)이 '토큰당 비용'으로 환산됩니다. 공짜가 아니라 비용 구조가 달라지는 거예요. 규모가 커질수록 자체 운영이 더 저렴해지는 손익분기점이 있어요.

Q5. 추론 모델이 항상 더 좋은 답을 주나요?

아니요. 학계 연구에서도 토큰을 많이 쓴다고 결과가 항상 좋아지는 건 아니었어요. 오히려 단순한 질문에 추론 모드를 쓰면 과잉 사고로 엉뚱한 답을 내기도 합니다. 태스크 난이도에 맞춰 선택하셔야 해요.

정리하자면

토큰은 AI가 글을 읽는 가장 작은 단위이자, 지금 AI 산업의 가격과 성능을 결정하는 기본 통화입니다. 사용자 눈에는 자연어 대화처럼 보이지만, 그 안에서는 수많은 토큰이 숫자로 변환되어 GPU를 통과하고 있어요.

B2B에서 AI를 도입하실 때 토큰 개념을 이해하는 건 이제 선택이 아닌 필수가 되어가고 있습니다. 한국어라는 언어적 불리함, 추론 모드의 숨은 비용, 컨텍스트 윈도우와 캐싱의 영향, 에이전트 워크로드의 폭발적 토큰 소비. 이 모든 것이 한 달 청구서에 그대로 반영되니까요.

젠슨 황이 GTC 2026 무대에서 토큰을 'AI의 통화'라고 부른 건 수사가 아니라 현재 업계의 실제 지표예요. AI 팩토리가 더 많은 토큰을 더 빠르고 싸게 만들 수 있는가가 인프라 경쟁의 본질이 되었고요. 다음에 AI 도입을 검토하실 때, '토큰당 얼마인가'라는 한 문장을 가장 먼저 꺼내보시기를 권합니다.