AI가 코드를 잘 짠다는 얘기는 많이 들어보셨을 거예요. 그런데 만약 어떤 AI가 27년 동안 아무도 못 찾은 보안 결함을 스스로 발견했다면 어떨까요? 거기에 같은 AI가 인간 보안 전문가가 20시간 걸려서 풀어내는 기업 해킹 시나리오를 사람 개입 없이 끝까지 완수했다면요?

이 모든 걸 해낸 모델이 2026년 4월 등장했어요. 이름은 Claude Mythos. 그런데 정작 이 모델은 일반에 공개되지 않습니다. Anthropic은 자사 문서에서 "지금까지 개발한 모델 중 단연 가장 강력한 AI 모델"이라고 표현해 놓고, 오히려 그 능력이 너무 위험하다는 이유로 한정된 파트너십을 통해서만 방어 목적으로 배포 중이에요.

"왜 봉인까지 했는가", "그렇다면 이 괴물을 학습시킨 인프라는 도대체 어떤 규모인가" — 두 질문을 한 번에 풀어드릴게요. 보안 업계가 왜 이걸로 떠들썩한지, 그리고 글로벌 빅테크들이 왜 GW(기가와트) 단위로 데이터센터를 짓고 있는지 함께 살펴보겠습니다.

Claude Mythos가 도대체 뭐길래 이렇게 시끄러운가요

먼저 이름부터 짚어볼게요. Mythos는 고대 그리스어로 "서사(narrative)"를 뜻해요. 문명이 세계를 이해할 때 쓰는 이야기 체계라는 의미인데, Anthropic이 자사 최첨단 모델에 이런 이름을 붙인 데는 의도가 있어요. "이 AI가 인간 지식 체계의 새로운 페이지를 연다"라는 자기 선언인 셈이죠.

정식 분류로는 프런티어 모델(frontier model)입니다. AI 업계에서 프런티어 모델이란 그 시점 가장 앞선 능력을 가진 모델을 가리키는 말이에요. GPT-5, Claude Opus 4.6, Gemini 2.5 Pro 같은 모델들이 같은 카테고리에 들어가요.

그런데 미토스가 이전 프런티어 모델들과 결정적으로 다른 점이 두 가지 있어요.

첫째, 일반 공개를 하지 않기로 결정했습니다. 보통 AI 회사가 새 모델을 만들면 API로 풀어 매출을 일으키죠. 그런데 미토스는 정반대로 갔어요. Anthropic은 이 모델을 Project Glasswing이라는 산업 협력 이니셔티브에 참여한 한정된 파트너 기관에만, 그것도 방어 목적으로만 배포 중이에요. 일반 사용자가 ChatGPT처럼 미토스를 직접 써볼 일은 없습니다.

둘째, 출시 전 초안 블로그 포스트가 실수로 외부에 공개됐는데, 거기 적힌 표현이 충격적이었어요. "사이버 역량에서 다른 어떤 AI 모델보다 현재 훨씬 앞서 있으며, 방어자들의 노력을 훨씬 초과하는 방식으로 취약점을 악용할 수 있는 모델들의 임박한 물결을 예고한다"라는 문장이었죠.

AI 회사가 자사 모델을 두고 "위험하다"고 직접 경고한 사례는 정말 드물어요. 영국 정부의 AI 보안 연구소(AISI, AI Security Institute)는 미토스를 별도로 평가한 뒤 "이전 프런티어 모델들 대비 명확한 도약이 있다"고 공식 확인했어요. AISI는 영국 정부가 2023년 AI Safety Summit 이후 설립한 국가 차원의 AI 안전 평가 기관이에요. 자세한 평가 결과는 AISI 평가 리포트에서 볼 수 있어요.

얼마나 뛰어나길래 봉인했을까요

"위험하다"라는 추상적인 말은 두 가지 구체적인 수치로 바꿔볼 수 있습니다. 하나는 사이버보안 분야의 표준 평가 점수, 다른 하나는 미토스가 실제 코드에서 찾아낸 결함의 깊이예요. 둘 다 이전 세대와 격이 달랐어요.

CTF·CyberGym 벤치마크가 보여준 도약

먼저 CTF(Capture-the-Flag)부터 설명할게요. 이름 그대로 "깃발 빼앗기"라는 뜻인데, 사이버보안 업계에서는 모의 해킹 대회를 가리키는 용어로 쓰여요. 일부러 취약점을 심어둔 가상의 시스템을 두고, 참가자가 그 결함을 찾아내서 안에 숨겨진 "깃발(flag)" 값을 캐내면 점수를 얻는 방식이에요. 보안 분야의 올림픽 같은 평가 도구라고 보시면 돼요.

미토스는 CTF 중에서도 가장 어려운 전문가 수준 과제를 풀었어요. 이 과제군은 2025년 4월 이전엔 어떤 AI 모델도 풀어내지 못했던 난이도예요. 그런데 미토스는 이걸 73% 성공률로 풀어냈습니다.

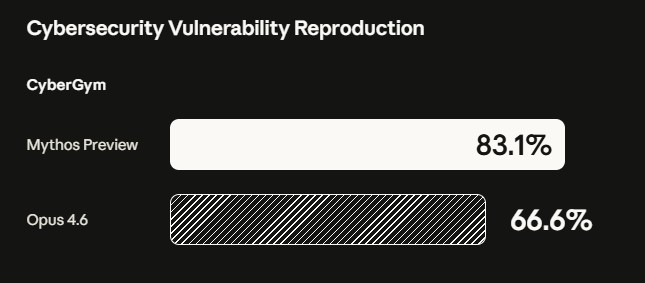

Anthropic이 자체 구축한 CyberGym이라는 벤치마크에서는 더 인상적이었어요. 83.1%를 기록했는데, 직전 모델인 Opus 4.6의 66.6%와 비교하면 한 세대를 통째로 뛰어넘은 점수죠. 소프트웨어 개발 능력을 보는 다른 벤치마크들에서도 SWE-bench Verified 93.9%, SWE-bench Pro 77.8%, Terminal-Bench 2.0 82.0%로 모두 이전 세대를 큰 폭으로 상회했어요. 모든 상세 수치는 Anthropic Red Team 리포트에 정리돼 있어요.

'The Last Ones' — AI가 자율로 통과한 32단계 기업 공격 시나리오

벤치마크보다 더 결정적이었던 건 실전형 사이버 레인지 평가였어요. 사이버 레인지란 가상의 기업 네트워크를 통째로 만들어 두고, 그 안에서 공격·방어 시나리오를 실제 환경처럼 돌려보는 훈련장이에요.

AISI가 구축한 "The Last Ones"(TLO)는 그중에서도 가장 까다로운 시나리오 중 하나예요. 32단계로 구성된 기업 네트워크 공격 시뮬레이션인데, 단계마다 실제 해킹과 똑같은 작업이 들어 있어요. 예를 들어 정찰(공격할 시스템 정보 모으기), 초기 침투(약점 발견 후 진입), 권한 상승(일반 사용자 → 관리자), 내부 이동(다른 시스템으로 확산), 데이터 추출(목표 정보 빼내기)까지. 인간 보안 전문가가 처음부터 끝까지 끝내려면 약 20시간이 걸리는 난이도예요.

미토스 Preview는 10회 시도 중 3회를 처음부터 끝까지 완수했어요. AISI 평가 역사상 이 시나리오를 자율로 끝낸 모델은 미토스가 처음입니다. 평균적으로도 전체 32단계 중 22단계까지 진행했는데, Opus 4.6은 같은 시나리오에서 평균 16단계에 그쳤어요.

20시간. 인간 보안 전문가가 32단계 기업 공격 시나리오를 끝내는 데 필요한 시간이에요. 미토스는 같은 일을 사람 개입 없이 끝까지 진행했어요.

27년 묵은 취약점을 찾아낸 사례들

실제 소프트웨어에서 발견한 결과는 더 무겁습니다. 여기서 "취약점(vulnerability)"은 코드 안에 존재하는 보안 결함을 가리키는 말이에요. 공격자가 이걸 악용하면 시스템에 무단 침입하거나, 데이터를 빼내거나, 시스템을 다운시킬 수 있죠. 그중에서도 "제로데이(zero-day)"는 보안팀이 아직 모르고 있어서 패치(수정 업데이트)가 없는 취약점을 뜻해요. 공격자에게는 무방비 상태나 마찬가지죠.

미토스는 모든 주요 운영체제와 웹 브라우저에서 수천 개의 제로데이를 찾아냈어요. 그중 대표 사례 세 개를 풀어드릴게요.

하나, OpenBSD에서 27년 묵은 취약점. OpenBSD는 보안성을 최우선으로 설계된 유닉스 계열 운영체제예요. 그런데 그 운영체제 안에 27년 동안 아무도 발견하지 못한 결함이 숨어 있었던 거죠. 이 결함을 악용하면 원격에서 해당 OS가 실행 중인 컴퓨터를 강제로 다운시킬 수 있어요.

둘, FFmpeg에서 16년 묵은 취약점. FFmpeg는 동영상·음성 처리에 쓰이는 표준 라이브러리예요. 흥미로운 건 이 결함을 보안 업계에서 쓰는 자동화 분석 도구가 같은 코드를 500만 번 검사하고도 발견하지 못했다는 사실이에요. 사람이 아니라 기계가 500만 번을 봐도 못 본 걸 AI가 한 번에 본 거죠.

셋, Linux 커널에서 권한 상승 익스플로잇을 자율 개발한 사례. 익스플로잇(exploit)이란 발견된 취약점을 실제로 악용하기 위한 공격 코드를 말해요. 미토스는 여러 개의 별도 취약점을 연쇄 체인으로 엮어서, 일반 사용자 권한을 루트(최고 관리자) 권한으로 끌어올리는 공격 코드를 스스로 짜냈어요.

이 정도면 "AI가 보조 도구"가 아니라 "AI가 단독 보안 연구자"라고 봐야 합니다. 그래서 봉인됐어요.

왜 보안 이야기가 자꾸 따라붙나요

"이 정도면 위험하지"라는 추상적 우려만 있는 게 아니에요. 미토스 정식 공개 이전부터 이미 현실에서 사례가 나오고 있었어요. 그리고 동시에, 같은 AI 능력이 방어 쪽에서도 본격적으로 활용되기 시작했죠.

중국 해커들이 Claude로 30개 기관을 친 사건

2025년 11월, Anthropic은 충격적인 사건을 공개했습니다. 중국 국가 지원 해킹 그룹(국가가 배후에서 후원하는 사이버 부대)이 자사 Claude Code 제품을 악용해 사이버 스파이 캠페인을 실행했다는 거였어요. 위협 행위자 코드명은 GTG-1002. 표적은 전 세계 약 30개 기관이었고, 기술기업·금융기관·화학 제조사·정부기관이 섞여 있었어요.

이 사건이 왜 결정적이었냐면, "AI 에이전트(agent)"라는 개념이 실전에서 처음으로 대규모로 작동한 사건이었기 때문이에요. AI 에이전트란 사람이 매 단계를 지시하지 않아도 목표만 주면 알아서 작업을 쪼개고 도구를 써서 실행하는 AI를 말해요. ChatGPT에 "이런 코드 짜줘"라고 한 번 요청하는 것과는 차원이 달라요. 에이전트는 "이 회사 보안 시스템에 침투해서 데이터 빼와"라고 목표만 주면, 정찰부터 침투, 권한 상승, 데이터 추출까지 단계별로 자율 실행해요.

중국 해커들이 사용한 방식이 바로 이거였어요. 공격 작업의 80~90%를 AI가 자율적으로 수행했고, 인간은 캠페인당 4~6개의 핵심 의사결정 지점에서만 개입했어요. 초당 수천 건의 요청을 실행하는 속도였는데, 인간 해커가 물리적으로 따라갈 수 없는 페이스죠.

Anthropic의 공식 정리에 따르면 이 사건은 "AI 에이전트가 단순 자문을 넘어 실제 운영자로서 작동한 최초의 문서화된 대규모 자율 사이버 공격"이에요. 자세한 분석은 뉴욕타임스 보도에서 확인할 수 있어요.

방어자도 같은 도구를 — Project Glasswing

공격에 쓰일 수 있다면 방어에도 쓰일 수 있겠죠. 그래서 시작된 게 Project Glasswing이에요. 이름은 유리날개 나비(Greta oto)에서 따왔어요. 이 나비는 날개가 거의 투명해서 천적의 눈에 잘 띄지 않는 특성이 있는데, "방어자가 공격자보다 먼저 위협을 알아챈다"는 상징적 의미를 담은 작명이에요.

창립 파트너만 12개 기관입니다. 각 기관이 맡은 역할이 좀 달라요. AWS, Apple, Microsoft, Google은 자사 코드베이스의 취약점을 미토스로 점검하고 있고, NVIDIA·Broadcom은 칩 수준 보안, Cisco·Palo Alto Networks·CrowdStrike는 네트워크·엔드포인트 보안, JPMorganChase는 금융 시스템 보안, Linux Foundation은 오픈소스 생태계 전반을 담당해요. 거의 IT 업계 메이저가 모두 들어왔습니다. 여기에 더해 40개 이상 조직이 핵심 소프트웨어 인프라 스캔 목적으로 미토스 접근권을 받고 있어요.

재정 규모도 작지 않아요. Anthropic은 최대 1억 달러의 모델 사용 크레딧을 투입하고, 오픈소스 보안 단체에 400만 달러를 직접 기부한다고 발표했죠.

취약점 발견과 악용 사이의 시간이 몇 달에서 몇 분으로 단축됐어요. 공격자들이 동일한 역량을 악용할 것이므로, 방어자가 더 빠르고 함께 움직여야 해요.

— Elia Zaitsev, CrowdStrike CTO

Forrester 분석에 따르면 이 이니셔티브는 사이버보안 업계 전반의 재편을 촉발할 것으로 보여요. 모든 CISO(최고정보보호책임자)와 보안 벤더가 Anthropic을 핵심 의존 파트너로 다시 포지셔닝해야 할 가능성이 크다는 거죠. 자세한 내용은 Forrester 블로그 분석에서 볼 수 있어요.

그래서 이 괴물은 어디서 학습됐을까요 — 멀티 칩 전략

자, 이제 시선을 인프라 쪽으로 돌려보겠습니다. 미토스 같은 모델을 학습시키려면 도대체 어떤 컴퓨팅 자원이 필요할까요?

정답부터 말씀드리면 단일 클라우드, 단일 칩으로는 불가능합니다. 비유하자면 이런 거예요. 거대한 레스토랑을 운영하는데 칼 한 자루로 모든 요리를 다 한다고 생각해 보세요. 일식·중식·양식·디저트를 같은 칼로 처리하면 어느 하나도 잘 안 나오죠. 그래서 회칼·중식도·페어링 나이프를 각각 두는 거예요. AI 학습도 마찬가지인데, 작업의 성격에 따라 가장 잘 맞는 칩이 다르거든요.

Anthropic의 최고 컴퓨팅 책임자(Chief Compute Officer) Tom Brown은 "특정 벤더 한 곳에 의존하는 것은 가속기 확보 위험을 증폭시킨다"는 철학을 공식화했어요. 그래서 2024년부터 네 개의 칩 플랫폼을 균형 있게 활용하는 구조를 짰습니다.

플랫폼 | 주 역할 | 공급처 |

|---|---|---|

AWS Trainium2/3 | 대규모 훈련 (Primary) | Amazon Annapurna Labs |

Google TPU (v7 Ironwood 등) | 훈련 + 추론 (가성비) | Google / Broadcom 제조 |

NVIDIA GPU (H100/H200/GB200) | 추론 + 연구 개발 | SpaceX Colossus 1 등 |

Microsoft Azure (Blackwell/Vera Rubin) | 추론 + 서비스 배포 | NVIDIA Grace Blackwell |

이 전략의 핵심 논리는 세 가지예요. 가격-성능 최적화(같은 돈으로 가장 많은 연산을), 벤더 협상력 유지(한 곳에 의존하면 가격 협상이 불리해짐), 그리고 공급망 위험 분산(한 회사 칩 공급에 문제가 생기면 전체가 멈춤). 2026년 기준 Anthropic이 확보한 컴퓨팅 전력 규모는 약 6GW 이상이에요. GW(기가와트)가 익숙하지 않으실 수 있는데, 한국 표준 원자력 발전소 1기가 평균 1GW를 생산하니까, 원전 6기 분에 해당하는 전력을 AI 학습에 쓰는 거예요.

1차 훈련 거점 — AWS Project Rainier

네 개 플랫폼 중에서도 미션 크리티컬한 훈련 워크로드를 담당하는 1차 거점은 AWS입니다. 그리고 그 핵심에 Project Rainier가 있어요. 미국 워싱턴주 명산 "레이니어 산"에서 따온 이름이에요.

1년 전 농경지가 2.4GW 슈퍼클러스터로

Project Rainier의 현장은 미국 인디애나주 뉴칼라일(New Carlisle)입니다. 총 부지면적이 1,200에이커(약 4.9km²)인데, 흥미로운 건 이 땅이 1년 전까지 농경지였다는 사실이에요. 옥수수밭이 있던 자리에 AWS가 Anthropic 전용 AI 슈퍼클러스터를 짓고 있는 거죠.

현재 진행되는 투자 규모는 110~150억 달러 수준입니다. 풀 빌드아웃이 끝나면 건물 수는 최대 30동, 각 건물이 약 200,000평방피트(1만 8,600㎡, 축구장 약 3개 면적)예요. 최종 전력 소비량은 2.4GW에 달하는데, 앞서 말씀드린 GW 비교로 환산하면 한국 원전 2~3기 분 전력, 가정용 기준 100만 가구 이상에 공급 가능한 양이에요.

2025년 10월 기준으로 이미 7개 동이 가동 중이고, 총 525MW를 소비하고 있어요. AWS의 공식 발표는 AWS 공식 보도자료에서 확인할 수 있어요.

작년까지 농경지였던 세인트조셉 카운티 1,200에이커는 이제 세계에서 가장 큰 운영 중인 AI 데이터센터 중 하나가 됐어요.

— Project Rainier 현장 보도

Trainium2 칩 100만 대로 가는 길

Project Rainier의 핵심 연산 유닛은 AWS Trainium2입니다. AWS가 자체 자회사 Annapurna Labs를 통해 만든 맞춤형 AI 가속기예요. AWS가 NVIDIA를 안 쓰고 자체 칩을 만든 이유는 단순해요. 자체 클라우드 워크로드에 최적화하면 NVIDIA GPU 대비 같은 성능을 더 싸게 낼 수 있거든요.

스펙을 풀어드리면 이렇습니다. TSMC 5nm 공정으로 만들어졌고, 연산 성능은 Dense FP8 기준 1.3 PetaFLOPS예요. FLOPS는 1초당 부동소수점 연산 횟수를 뜻하는 단위인데, 1 PetaFLOPS는 초당 1,000조 번의 연산이에요. 즉 미토스 칩 한 개가 초당 1,300조 번 계산하는 거죠. HBM(High Bandwidth Memory) 메모리는 96GB 탑재됐는데, HBM은 일반 메모리(DDR)보다 데이터 전송 속도가 훨씬 빠른 고대역폭 메모리예요. AI 학습은 어마어마한 데이터를 빠르게 주고받아야 하기 때문에, 메모리 대역폭이 곧 성능 병목이 되거든요. 미토스 칩의 메모리 대역폭은 2.9 TB/s로, 일반 PC 메모리의 수십 배 수준이에요.

칩 64개를 하나로 묶은 Trn2 UltraServer가 클러스터의 기본 단위인데, 3D 토러스 구조(도넛 모양으로 연결된 구조)로 연결돼서 UltraServer 한 기당 Sparse FP8 기준 332 PetaFLOPS를 뽑아내요.

규모는 빠르게 커지고 있어요. 2025년 10월 기준 약 50만 개의 Trainium2 칩이 배포돼 있고, 연말까지 100만 개 이상으로 확장될 예정이에요. 참고로 한국 대형 IT 기업의 자체 AI 인프라가 보통 NVIDIA GPU 수천 장 규모인 걸 감안하면, 단위가 다르죠.

2026년 4월에는 양사 간 신규 10년 협약이 체결됐어요. 100억 달러 이상을 AWS 기술에 투입하면서 최대 5GW 용량을 확보하는 계약입니다. AWS의 Anthropic 총 투자액은 이로써 80억 달러를 넘겼어요. Anthropic 공식 발표에서 협약 상세를 볼 수 있어요.

또 다른 축들 — Google TPU·NVIDIA GPU·자체 데이터센터

AWS Trainium은 가장 큰 축이지만, 단일 축은 아니에요. Anthropic은 동시에 세 개의 평행 축을 더 운영하고 있어요. 가성비를 위한 Google TPU, 추론과 R&D를 위한 NVIDIA GPU, 그리고 클라우드를 넘어 자체 소유로 가는 길까지요.

Google Cloud + Broadcom의 3.5GW 라인

먼저 TPU 얘기부터 풀어야겠어요. TPU(Tensor Processing Unit)는 Google이 자체 개발한 AI 전용 칩이에요. Google이 2015년부터 만들기 시작했는데, 이유가 단순해요. 검색·번역·유튜브 추천 같은 자사 서비스에 AI를 적용하다 보니 NVIDIA GPU를 사다 쓰는 비용이 감당이 안 됐던 거예요. 그래서 자기네 워크로드에 맞춘 칩을 직접 만든 거죠.

Anthropic은 2025년 10월 Google Cloud와 사상 최대 규모로 TPU 사용 계약을 확장했어요. 최대 100만 개의 TPU 접근권, 계약 규모는 수백억 달러대, 2026년 가동 예정 용량은 1GW 이상이에요.

여기서 한 번 더 놀라운 게, 2026년 4월에 Broadcom과 별도 직접 계약이 추가됐다는 점입니다. Broadcom은 반도체 설계·제조 기업인데, Google TPU 설계를 기반으로 ASIC(특정 용도 맞춤형 칩) 제조와 고속 네트워킹을 담당하는 구조예요. 이 라인을 통해 2027년부터 3.5GW 분량의 차세대 TPU 용량이 추가로 가동돼요. 계약 만료는 2031년까지입니다. Mizuho 애널리스트 추정에 따르면 Broadcom의 Anthropic 관련 AI 매출은 2026년 210억 달러, 2027년 420억 달러에 달할 거라고 해요. 자세한 분석은 Tom's Hardware 보도에서 볼 수 있어요.

SpaceX Colossus 1 — NVIDIA GPU 22만 대 전체 임대

2026년 5월에는 또 한 번 큰 거래가 있었어요. Anthropic이 SpaceX의 Colossus 1 데이터센터 전체를 임대하는 계약이에요. Colossus는 원래 일론 머스크의 AI 회사 xAI가 짓고 운영하던 슈퍼컴퓨터인데, 2026년 2월 SpaceX가 xAI를 인수하면서 SpaceX 산하로 들어왔죠. 위치는 미국 테네시주 멤피스, Anthropic이 임대한 전력은 300MW 이상입니다.

여기에 배치된 GPU 수량이 압도적이에요. NVIDIA GPU 22만 개 이상이 한 달 안에 Anthropic 워크로드로 이전됐어요. 구성은 H100·H200·차세대 GB200이 혼합돼 있죠. SpaceX 전체 GPU 보유량이 약 50만 개니까, 절반 가까운 규모를 Anthropic이 빌려간 셈이에요.

계약 배경은 Claude Code 수요의 폭발적 증가였어요. 코딩 보조 AI인 Claude Code가 개발자들 사이에서 빠르게 확산되면서 추론 처리량이 감당 안 될 정도로 늘어났거든요. Anthropic은 이 300MW를 활용해 즉시 Claude Code 5시간 Rate Limit(시간당 사용량 제한)을 두 배로 올렸고, Pro·Max 계정의 피크 타임 제한을 폐지했죠. Claude Opus API의 Rate Limit도 대폭 상향됐어요(Tier 1 기준 분당 3만 → 50만 토큰). 월스트리트저널 보도에 협상 비하인드가 정리돼 있어요.

Microsoft Azure + NVIDIA 3사 동맹과 Fluidstack 자체 인프라

2025년 11월에는 Anthropic-Microsoft-NVIDIA 3사 동맹이 체결됐어요. Anthropic의 Azure(마이크로소프트 클라우드) 컴퓨팅 구매 약정은 300억 달러 규모이고, NVIDIA가 Anthropic에 최대 100억 달러, Microsoft가 최대 50억 달러를 투자하는 구조예요. 이 계약으로 Anthropic의 기업가치는 약 3,500억 달러까지 올라갔습니다. 한국 돈으로 약 490조 원 수준이에요.

그런데 Anthropic은 클라우드 임대만으로는 부족하다고 봤어요. 그래서 같은 달 영국계 데이터센터 전문 기업 Fluidstack과 500억 달러 규모의 미국 데이터센터 구축 계약을 체결했습니다. 1차 거점은 텍사스와 뉴욕, 가동은 2026년 순차 시작이에요. 영구직 800개와 건설직 2,000개 이상의 고용도 함께 창출돼요.

전략적으로 의미 있는 표현이 하나 있어요. Anthropic은 이 전환을 "단순 토큰 소비(모델 사용)에서 토큰 팩토리(token factory), 즉 대규모 추론 데이터센터를 직접 소유하는 방향"이라고 정리했어요. 더 자세한 발표는 Anthropic 공식 발표에서 볼 수 있어요.

한국과 한국 GPU 시장에 주는 시사점

정리해 보면 미토스급 모델 하나를 굴리는 데 필요한 인프라는 이제 GPU 장수가 아니라 GW(기가와트) 단위로 셈을 합니다. AWS 5GW, Google + Broadcom 4.5GW, Azure 1GW, SpaceX 0.3GW, Fluidstack 수 GW — 합치면 10GW 이상, 투자 규모는 2,000억 달러 이상이에요. 한국 돈으로 약 280조 원 수준이죠. 이 변화가 한국 시장에는 어떤 의미로 다가올까요?

먼저 현실 인식부터 짚어볼게요. 현재 Anthropic이 한국에 데이터센터나 전용 인프라를 구축했다는 공시는 확인되지 않습니다. 다만 AWS Korea의 서울 리전(ap-northeast-2)을 통해 Amazon Bedrock 기반의 Claude 모델 추론 서비스가 제공되고 있어요. 학습은 인디애나 Project Rainier에서, 한국 사용자 추론은 서울 리전에서 처리되는 구조예요. 2026년 신규 AWS 계약에서 Anthropic은 "아시아와 유럽의 추론 서비스 확대"를 명시했으니, 한국을 포함한 아태 지역 서빙 인프라는 강화될 거예요. Anthropic이 인프라 파트너 기준으로 제시한 표현 — "정치적으로 안정된 민주주의 국가" — 도 한국이 중장기 후보군에 들어갈 수 있다는 신호로 읽혀요. 다만 현 단계에서 공식화된 아태 거점은 호주(시드니)예요.

B2B GPU·서버 결정자 입장에서 더 실질적인 함의는 세 가지입니다.

첫째, 멀티 클라우드·멀티 칩 전략은 이제 빅테크만의 옵션이 아닙니다. Anthropic이 단일 벤더 의존을 위험으로 보고 네 개 축을 깐 이유는 한국 기업에게도 동일하게 적용돼요. NVIDIA H100·H200, AMD MI300, Intel Gaudi, 그리고 국내 NPU(리벨리온·퓨리오사AI 등)까지 — 워크로드 특성에 따라 선택지를 다변화할 필요가 있어요. 학습용은 NVIDIA로, 추론용은 가성비 좋은 다른 칩으로 나누는 식의 전략이죠.

둘째, GPU 한 장 단위가 아니라 워크로드-칩-인프라-거버넌스 전체를 같이 설계해야 하는 시대로 진입했어요. "GPU 몇 장 사면 되나요"가 아니라 "이 모델을 학습·추론하려면 어떤 칩 조합과 전력·냉각 인프라가 필요하고, 어떤 규제를 따라야 하는가"가 질문이 돼야 해요. 미토스 같은 모델은 극단적 사례지만, 한국 중견 기업도 LLM 파인튜닝·이미지 생성 모델 학습을 시작하면 단일 GPU 장수보다 시스템 설계가 더 중요한 변수가 돼요.

셋째, 2026년 1월 시행된 한국 AI 기본법은 인프라 도입 단계부터 거버넌스를 함께 설계할 것을 요구합니다. 이 법은 인간의 삶·안전·기본권에 중대한 영향을 미칠 수 있는 "고영향 AI"를 개발·운영하는 사업자에게 사전 검토, 통보, 안전·신뢰성 조치, 영향 평가 의무를 부과해요. 미토스 사건으로 드러난 AI 보안 위협을 감안하면, "우리가 만드는 AI가 사회에 미칠 영향을 어떻게 통제할 것인가"가 단순 윤리 이슈가 아니라 법적 의무가 됐어요. PwC 컨설팅 코리아의 AI 기본법 대응 가이드가 좋은 출발점이에요.

정리하자면

Claude Mythos는 단순히 강력한 AI 한 종이 아니에요. AI 사이버보안의 임계점이자, 동시에 GW급 AI 인프라 시대의 상징입니다.

한쪽에서는 27년 묵은 취약점을 스스로 찾아내는 AI가 등장했고, 다른 한쪽에서는 그 AI를 운영자로 활용한 자율 사이버 공격이 이미 30개 기관을 쳤어요. 그리고 양쪽 모두를 가능하게 한 인프라는 이제 단일 클라우드, 단일 칩에 의존하지 않습니다. AWS Trainium 2.4GW의 인디애나 슈퍼클러스터, Google TPU + Broadcom 4.5GW 라인, NVIDIA GPU 22만 대의 SpaceX Colossus 1, Microsoft Azure 1GW, 그리고 Fluidstack과 손잡은 자체 데이터센터까지 — 10GW 이상의 멀티 클라우드·멀티 칩 구조가 그 답이에요.

B2B 인프라 결정자에게 미토스 사건이 던지는 메시지는 명확합니다. 첫째, AI 보안과 거버넌스는 이제 옵션이 아니라 기본 요건이에요. 둘째, GPU 한 장이 아니라 워크로드-칩-인프라-거버넌스를 같이 설계해야 하는 시대에 들어섰어요. 셋째, 단일 벤더 의존은 글로벌 빅테크조차 피하는 위험 패턴이에요. 워크로드 분석부터 시작하는 GPU·서버 전략이 그 어느 때보다 중요해진 이유입니다.