정부와 기업들이 수조 원을 투자하며 확보하려는 H100, H200, B200. 이 작은 칩 하나가 왜 전 세계 확보 경쟁의 중심에 있는 걸까요?

그 답은 단순히 '성능이 좋아서'라는 말로는 부족해요. AI 모델을 학습시키고 실행하는 능력에서 기존의 어떤 하드웨어도 따라올 수 없는 압도적인 성능, 그것이 이 GPU들의 가격과 수요를 만들어낸 진짜 이유예요.

H100 GPU 한 장의 대기 시간은 6개월에서 12개월. B200은 2025년 전체 생산분이 이미 완판되었다는 보도가 나올 정도예요. 이 글에서는 H100, H200, B200 각 GPU의 기술적 특징과 실제 비즈니스 가치, 그리고 여러분의 조직에 어떤 GPU가 적합한지를 상세히 분석해 볼게요.

"데이터센터는 새로운 공장이고, GPU는 새로운 석유다. AI 시대에 GPU 없는 기업은 산업혁명 시대에 증기기관 없는 공장과 같다." — 젠슨 황, NVIDIA CEO

GPU란 무엇이며, 왜 AI에 필수적인가?

GPU (Graphics Processing Unit)는 원래 게임과 그래픽 렌더링을 위해 개발되었어요. 하지만 AI 시대가 도래하면서 그 역할이 완전히 변화했죠. CPU가 복잡한 논리 연산을 순차적으로 처리하는 데 특화되어 있다면, GPU는 수천 개의 간단한 연산을 동시에 병렬로 처리하는 데 최적화되어 있어요.

AI 모델, 특히 딥러닝은 방대한 양의 행렬 연산을 필요로 해요. 예를 들어 GPT-3를 학습시킬 때는 수조 개의 계산을 동시에 수행해야 하죠. 이런 작업에 CPU를 사용하면 355년이 걸리지만, GPU를 사용하면 단 34일 만에 완료할 수 있어요.

비교 항목 | CPU | GPU (NVIDIA H100) |

|---|---|---|

GPT-3 학습 시간 | 약 355년 | 약 34일 |

병렬 처리 코어 수 | 8~128개 | 16,896개 CUDA 코어 |

이러한 압도적인 차이가 GPU를 AI 시대의 필수 인프라로 만들었어요.

GPU 사양, 이것만 알면 된다

GPU 사양표에 나오는 복잡한 용어들, 사실 핵심만 이해하면 어렵지 않아요. 마치 자동차를 살 때 마력, 토크, 연비를 확인하듯이, GPU도 몇 가지 핵심 지표만 파악하면 돼요.

사양 | 의미 | 비유 | H100 기준 |

|---|---|---|---|

TFLOPS | 초당 연산 능력 | GPU의 마력 | 3,958 TFLOPS (FP8) |

Tensor Core | AI 전용 연산 코어 | 공학용 계산기 | 528개 (4세대) |

CUDA Core | 일반 병렬 연산 코어 | 공장의 작업자 수 | 16,896개 |

GPU 메모리 | 모델/데이터 저장 공간 | 책상의 크기 | 80GB HBM3 |

메모리 대역폭 | 데이터 전송 속도 | 고속도로 차선 수 | 3.35 TB/s |

TFLOPS (테라플롭스)는 초당 1조 번의 부동소수점 연산을 수행하는 능력이에요. GPU의 마력이라고 생각하면 돼요. H100의 경우 FP8 기준 3,958 TFLOPS에 달하죠.

Tensor Core (텐서 코어)는 AI 연산에 특화된 전용 계산기예요. 딥러닝 모델은 대부분 행렬 계산으로 이루어져 있어서, Tensor Core가 많을수록 AI 성능이 좋아요.

GPU 메모리 (HBM3/HBM3e)는 AI 모델과 데이터를 임시로 저장하는 작업 공간이에요. 클수록 더 큰 모델을 한 번에 처리할 수 있죠. 메모리 대역폭은 데이터를 얼마나 빨리 읽고 쓸 수 있는지를 나타내요. 빨대와 소방호스의 차이라고 생각하면 돼요.

연산 정밀도 완벽 이해: FP64부터 FP8까지

GPU 사양에서 FP64, FP32, FP16, FP8 같은 숫자들이 바로 연산 정밀도예요. 뒤의 숫자는 사용하는 비트 수를 의미해요. 숫자가 클수록 정밀하지만 느리고, 작을수록 빠르지만 덜 정밀하죠. 자로 길이를 잴 때 밀리미터(mm) 단위로 재느냐, 센티미터(cm) 단위로 재느냐의 차이예요.

정밀도 | 비트 수 | 주요 용도 | H100 성능 |

|---|---|---|---|

FP64 | 64비트 | 과학 연구, 금융 계산 | 67 TFLOPS |

FP32 | 32비트 | AI 학습의 전통적 표준 | 67 TFLOPS |

TF32 | 32비트 | Transformer 학습 최적화 | 989 TFLOPS |

FP16 | 16비트 | AI 추론, 그래픽 렌더링 | 1,979 TFLOPS |

BF16 | 16비트 | 딥러닝 학습의 새 표준 | 1,979 TFLOPS |

FP8 | 8비트 | 초고속 AI 추론 | 3,958 TFLOPS |

INT8 | 8비트 | 경량 모델, 엣지 디바이스 | 3,958 TOPS |

FP8은 특히 중요한데요. FP16 대비 메모리를 1/4만 사용하면서 속도는 최대 2배까지 빨라져요. H100부터 본격 지원되면서 AI 추론 혁신을 이끌고 있죠.

혼합 정밀도 (Mixed Precision)는 중요한 부분은 FP32, 덜 중요한 부분은 FP16으로 처리하여 속도와 정확도를 동시에 확보하는 기술이에요. 최신 GPU는 이를 자동으로 수행하죠.

NVIDIA H100: 검증된 AI 가속기의 표준

NVIDIA 공식 스펙 기준으로 H100은 2022년 출시 이후 AI 업계의 사실상 표준 (de facto standard)이 되었어요. Hopper 아키텍처를 기반으로 하며, 이전 세대인 A100 대비 최대 4배 빠른 AI 학습 성능을 제공해요.

H100의 진짜 혁신은 4세대 Tensor Core와 FP8 정밀도 지원이에요. A100은 FP16까지만 지원했지만, H100은 FP8을 지원하여 같은 GPU로 2배 더 큰 모델을 실행하거나 2배 더 많은 사용자를 처리할 수 있게 되었죠.

H100 SXM 주요 사양 | 수치 |

|---|---|

아키텍처 | Hopper (GH100) |

트랜지스터 | 800억 개 |

CUDA 코어 | 16,896개 |

Tensor 코어 | 528개 (4세대) |

GPU 메모리 | 80GB HBM3 |

메모리 대역폭 | 3.35 TB/s |

FP8 Tensor Core 성능 | 3,958 TFLOPS |

TF32 Tensor Core 성능 | 989 TFLOPS |

NVLink 대역폭 | 900 GB/s |

전력 소비 (TDP) | 700W |

80GB의 HBM3 메모리는 70B (700억) 파라미터 모델을 FP16 정밀도로 실행하기에 충분해요. 초당 3.35TB의 메모리 대역폭이 이 방대한 데이터를 GPU 코어로 빠르게 공급하죠.

실제로 Llama 2 13B 모델 추론에서 H100은 초당 약 1,800개의 토큰을 처리할 수 있어요. ChatGPT, Claude 등 대부분의 AI 서비스가 H100 기반 인프라에서 실행되고 있죠.

H100의 가장 큰 장점은 검증된 안정성과 광범위한 소프트웨어 지원이에요. PyTorch, TensorFlow, JAX 등 모든 주요 AI 프레임워크가 H100에 최적화되어 있으며, 레퍼런스와 베스트 프랙티스가 풍부해요.

H100은 7B~70B 파라미터 모델, 검증된 프로덕션 AI 서비스, 대부분의 엔터프라이즈 AI 작업에 적합해요.

NVIDIA H200: 메모리 혁신으로 한계를 돌파하다

2024년 11월 출시된 H200은 H100의 진화형이에요. NVIDIA H200 공식 페이지에 따르면, 동일한 Hopper 아키텍처를 기반으로 하지만 가장 큰 차이점은 메모리 용량과 대역폭의 획기적인 증가예요.

사양 | H100 | H200 | 향상률 |

|---|---|---|---|

GPU 메모리 | 80GB HBM3 | 141GB HBM3e | +76% |

메모리 대역폭 | 3.35 TB/s | 4.8 TB/s | +43% |

FP8 Tensor Core | 3,958 TFLOPS | 3,958 TFLOPS | 동일 |

아키텍처 | Hopper | Hopper | 동일 |

전력 소비 | 700W | 700W | 동일 |

Llama 70B 추론 | 기준 | 최대 2배 | +100% |

배치 처리 능력 | BS 8 | BS 32 | 4배 증가 |

이 메모리 증가가 왜 중요할까요? AI 모델의 크기가 기하급수적으로 커지고 있기 때문이에요. H100으로는 70B 모델을 실행할 때 모델 병렬화(여러 GPU에 분산)가 필요했지만, H200은 단일 GPU에서도 처리가 가능해요. 개발 복잡도를 크게 줄이고 추론 속도를 높이죠.

HBM3e는 단순히 용량만 커진 게 아니에요. 5세대 고대역폭 메모리로, 각 메모리 칩의 전송 속도 자체가 빨라졌어요. 같은 도로를 더 빠른 차량들이 달리는 것과 같죠. 대역폭이 중요한 이유는, 아무리 많은 데이터를 저장할 수 있어도 빠르게 읽고 쓸 수 없다면 GPU 코어들이 데이터를 기다리며 놀게 되기 때문이에요.

실제 성능 테스트에서 Llama 2 70B 모델 추론에서 H200은 H100 대비 최대 2배 빠른 처리 속도를 보여줘요. H200의 또 다른 강점은 H100과의 완벽한 호환성이에요. 동일한 전력(700W)로 더 많은 메모리를 제공하므로, GPU만 교체하여 즉시 업그레이드할 수 있죠.

비즈니스 효과도 주목할 만해요. H100 2개를 H200 1개로 교체하면 하드웨어 비용 40% 절감이 가능하고, 처리량 2배 증가로 고객당 비용이 45% 감소하며, 개발 복잡도가 줄어들어 출시 시간도 단축돼요.

H200은 70B 이상 대형 LLM, 32K 토큰 이상 긴 컨텍스트, 메모리 병목 해결, 동시 사용자가 많은 AI 서비스에 적합해요.

NVIDIA B200: 차세대 Blackwell 아키텍처의 혁명

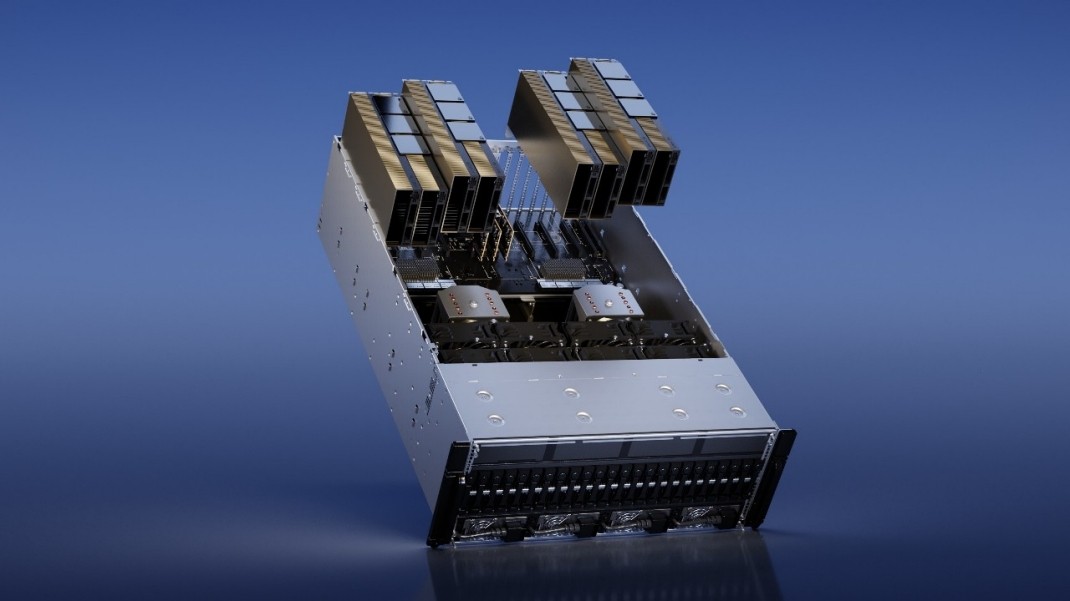

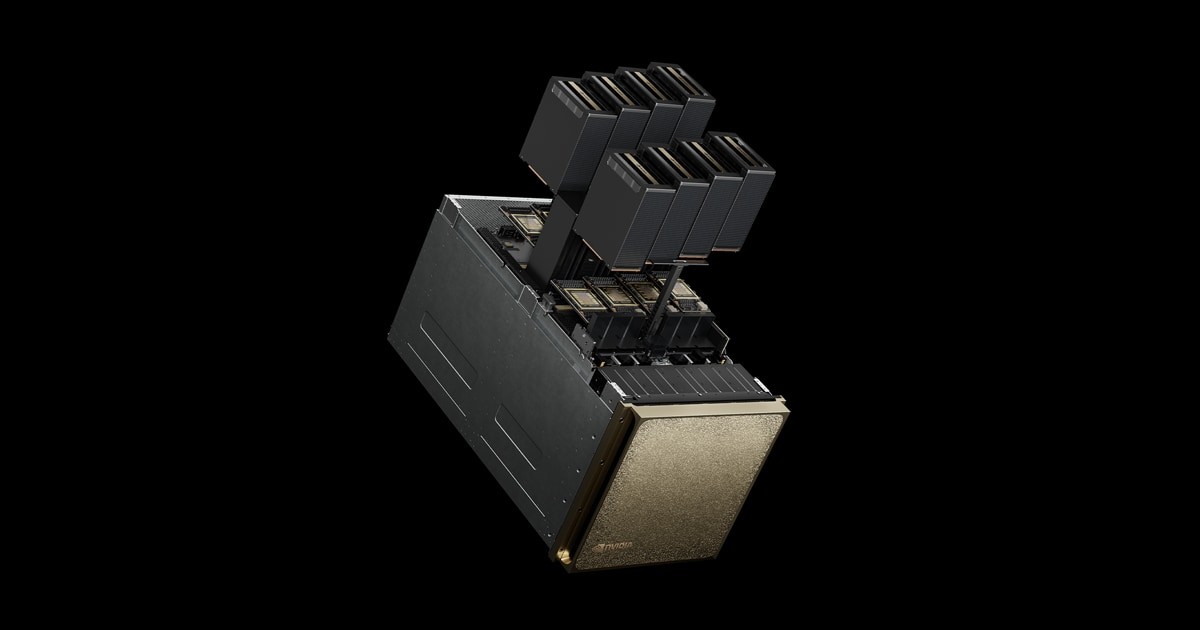

2024년 3월 공개된 B200은 NVIDIA의 차세대 Blackwell 아키텍처를 기반으로 해요. NVIDIA DGX B200 공식 페이지에 따르면, B200은 단순한 성능 향상이 아닌 완전히 새로운 차원의 AI 컴퓨팅을 제공하죠.

가장 눈에 띄는 특징은 2,080억 개의 트랜지스터를 탑재한 듀얼 칩 설계예요. 두 개의 독립적인 GPU 다이를 초고속 10TB/s NV-HBI 연결로 묶어서 마치 하나의 거대한 GPU처럼 작동해요.

사양 | H200 | B200 | 향상률 |

|---|---|---|---|

아키텍처 | Hopper | Blackwell (듀얼 칩) | 세대 교체 |

트랜지스터 | 800억 개 | 2,080억 개 | +2.6배 |

GPU 메모리 | 141GB HBM3e | 192GB HBM3e | +36% |

메모리 대역폭 | 4.8 TB/s | 8 TB/s | +67% |

FP8 성능 | 3,958 TFLOPS | 9,000 TFLOPS | +2.3배 |

신규 정밀도 | - | FP4 지원 | 신규 |

NVLink | 900 GB/s | 1.8 TB/s | 2배 |

전력 소비 | 700W | 1,000W | +43% |

추론 성능 (vs H100) | 최대 2배 | 최대 15배 | 7.5배 |

학습 성능 (vs H100) | 유사 | 최대 3배 | 3배 |

진짜 게임 체인저는 FP4 정밀도 지원이에요. FP4는 4비트로 소수점을 표현하는 혁신적인 기술로, FP8보다도 메모리를 절반만 사용하면서 실용적인 정확도를 유지해요. 이로 인해 단일 B200에서 GPT-4급 400B 파라미터 모델을 실행할 수 있게 되었죠.

2세대 Transformer Engine은 FP4와 FP8을 지능적으로 혼합하여 사용해요. 중요한 부분은 높은 정밀도로, 덜 중요한 부분은 낮은 정밀도로 자동 처리하여 성능과 정확도를 동시에 최적화하죠. Modal의 벤치마크에 따르면 B200은 MoE 모델에서 H200 대비 2.5배 낮은 TTFB (Time To First Byte)를 기록했어요.

다만 B200의 전력 소비는 1,000W로 H200 대비 43% 증가했어요. 데이터센터 관점에서 냉각 시스템과 전력 공급 설계를 재검토해야 하죠. 소프트웨어 최적화도 아직 진행 중이에요.

B200은 100B 이상 초대형 모델, 밀리초 단위 실시간 응답, 수만 명 동시 사용자 지원, 3~5년 장기 투자 관점의 인프라에 적합해요.

실제 비즈니스 가치: ROI 관점에서 본 GPU 선택

기술 스펙만으로는 부족해요. 클라우드로 운영할 경우와 자체 구축(온프레미스)을 비교해 보면, 2년 이상 지속적으로 사용한다면 온프레미스가 훨씬 경제적이에요. 정확한 비용 비교가 필요하시다면 견적 문의를 통해 최신 정보를 확인하시는 걸 추천드려요.

워크로드별 GPU 선택 가이드

선택 기준 | H100 | H200 | B200 |

|---|---|---|---|

적합 모델 크기 | 7B~70B | 70B~100B | 100B 이상 |

핵심 강점 | 검증된 안정성 | 메모리 확장 | 차세대 성능 |

투자 관점 | 즉시 도입 | 1~2년 확장 | 3~5년 장기 |

소프트웨어 성숙도 | 매우 높음 | 높음 | 진행 중 |

전력 소비 | 700W | 700W | 1,000W |

추천 조직 | 중소기업, 프로덕션 | 기존 H100 운영 기업 | 대형 테크, AI 선도 기업 |

산업별로도 선택이 달라져요. 금융권은 데이터 주권과 보안이 중요하므로 온프레미스를 선호하고, 스타트업은 초기 투자를 최소화하기 위해 클라우드로 시작하다가 사용량이 늘면 온프레미스로 전환하는 것이 일반적이에요. 대형 테크 기업은 B200을 대량 확보하여 차세대 AI 서비스 개발에 집중하고 있죠.

실제 사례를 보면 더 명확해요. 테슬라는 H100 1만 개 이상으로 '도조 슈퍼컴퓨터'를 구축했고, 메타는 35만 개의 H100을 자체 데이터센터에 설치할 계획이에요. 이들의 공통점은 자체 인프라 구축을 통한 장기적 비용 절감과 기술 주도권 확보예요.

정리하자면

H100, H200, B200. 이 세 가지 GPU는 각각 명확한 포지셔닝을 가지고 있어요.

GPU | 한 줄 요약 |

|---|---|

H100 | 검증된 현재 — 안정적인 프로덕션 환경의 표준 |

H200 | 확장된 현재 — 메모리 병목을 해결한 즉시 업그레이드 |

B200 | 투자하는 미래 — 차세대 AI를 위한 장기 인프라 |

2025년 현재는 GPU 투자의 최적기예요. 정부의 대규모 지원 정책, 안정화되는 공급망, 성숙해지는 AI 생태계. 이 모든 요소가 지금 GPU 인프라를 구축해야 하는 이유를 만들어주고 있어요.

여러분의 조직에 맞는 GPU는 무엇일까요? 현재의 워크로드, 향후 계획, 예산, 인프라 상황을 종합적으로 고려해야 해요. 하지만 한 가지 확실한 것은, GPU 인프라 없이는 AI 시대의 경쟁에서 살아남을 수 없다는 사실이에요.

어떤 GPU가 우리 팀에 맞는지 궁금하시다면, 엑스디노드에 편하게 문의해 주세요. 워크로드를 분석하고 최적의 구성을 함께 찾아드릴게요.